2026 年跑 AI 大模型,真正能打的 10 张卡

更新于 2026-05-05 · 预计阅读 9 分钟

知识库阅读进度92%

先交代一下

过去两年老有人问我同一个问题:"我想本地跑大模型,买什么卡?"一开始我还会认真问预算、问场景、问要跑多大的模型。后来问的人实在太多了,我干脆做了这个工具站——你把显卡型号或者预算输进去,它直接告诉你这张卡能跑哪些开源模型、大概跑多少 tok/s。省得自己翻显存表算半天。

但光甩工具也不行。很多人对显卡本身就没什么概念,你跟他说"上 H100"他都不知道那是啥。所以干脆写一篇,把我心里 2026 年上半年 AI 专业卡的前十名排出来。

先说清楚几件事。

第一,只排专业级和数据中心级,游戏卡不参与。RTX 5090 厉不厉害?厉害,32GB 显存玩 7B 模型很舒服。但它跟专业线压根不是一个路子——通道、散热、ECC、多卡互联,每一项都是两个世界的东西。消费卡排名改天另开一篇。

第二,不按跑分排。跑 AI 跟打游戏两码事,3DMark 分数屁用没有。看什么?三样:显存容量(能跑多大模型)、显存带宽(每秒吐多少 token)、算力(FP8/FP16 吞吐)。三项综合,除以价格。就这么简单。

第三,数据都是公开的。MLPerf Inference v6.0(今年 4 月最新)、各家白皮书、CloudRift/Spheron/Nebius 的第三方实测。价格是 2026 年 Q2 参考值,渠道价波动很大,别拿这个去跟经销商砍价。

行了,开始。

第 10 名:NVIDIA L40S

L40S 说白了就是 RTX 4090 的数据中心版——同一个 AD102 核心,显存翻倍到 48GB,加了 ECC,做成被动散热塞进服务器机箱。

48GB。这两年看确实有点不够用了,尤其现在 70B 模型满地跑。但 L40S 的核心优势从来不是容量——是便宜。直购五六万,已经是专业卡的门槛价了。

国内云厂商的 GPU 实例里,L40S 差不多是最便宜的。阿里云竞价,一小时两块多,7B-13B 推理能把成本压到地板:

- Qwen 3.5-9B FP16 占 18GB,剩下 30GB 全给 KV Cache,batch size 随便开

- Qwen 3.6-35B-A3B Q4——这模型的 MoE 设计太聪明了,35B 总量激活才 3B,又快又省显存,跟 L40S 简直是天作之合

但别对它有非分之想。70B 以上就算了,Q4 量化也就二十来 tok/s,体验像在泥里走路。而且没有 NVLink,多卡堆算力走 PCIe,那点带宽根本不够塞牙缝。

所以我把它放第十。不是性能怪兽,就是张踏踏实实干活的卡。你是个初创公司搭 7B-13B 推理 API?闭眼选它。

第 9 名:NVIDIA A100 80GB

A100,2020 年发布,五年多了。Ampere 架构,搁现在别说先进了,连 FP8 都不支持。

但就是这么一张"老古董",云上还在大量服役。而且我敢说,未来两年大概率退不了役。

为什么?因为该踩的坑全踩完了。CUDA 适配?完美。PyTorch 支持?完美。多卡 NVLink 600GB/s?稳得一批。MIG 切七个独立实例跑多租户?一个错都不带出的。这种"你只管用、别的不用操心"的确定性,在生产环境里比什么跑分都值钱。

价格也在持续跌。直购七八万,国内云厂商 A100 竞价已经跌到两三块一小时了。三年前你敢想?实测:

- Qwen 3.5-122B-A10B Q4 单卡能跑,25-35 tok/s,一个人够用了

- Qwen 3.5-27B FP16 单卡流畅跑,60+ tok/s

- 两张 A100 拿 NVLink 一接,Qwen 3.5-122B-A10B FP8 完全能打

说白了吧,你要是租云 GPU 跑推理的,A100 大概率还是你实际用到最多的那张卡。不是它最好,是它最稳、最便宜、最不用动脑子。

第 8 名:NVIDIA RTX PRO 6000 Blackwell

这张卡定位很特殊。不属于数据中心 SXM 线,也不属于消费 GeForce 线,卡在正中间的工作站专业卡。

96GB GDDR7 带 ECC。注意这个数字:96GB。消费级 5090 才 32GB,它直接三倍。而且还是 Blackwell 架构,第五代 Tensor Core,原生 FP4 支持——跟 B200 一样的待遇。直购五六万,工作站卡的天花板。

最骚的是它能干什么:单卡刚好能跑 Qwen 3.5-122B-A10B Q4。122B 的 MoE,一张卡搞定。第三方实测跑 Qwen 3.6-35B-A3B AWQ,一张卡 8,400 tok/s——差不多是四张 RTX 4090 摞在一起的水平,功耗却只有人家的一半。

云上竞价两三块一小时,比 H100 便宜一半还多。个人开发者或者小团队,这可能是目前单卡跑大模型性价比最高的方案。

但有个硬伤我很纠结:没有 NVLink。多卡走 PCIe 5.0,张量并行效率跟 NVLink 差了一个数量级。所以你只能当单卡用,堆卡就别想了。

不过说实话,96GB 单卡对绝大多数个人和小团队已经够了。跑不动 70B 的,7B-32B 那不是闭眼跑?

第 7 名:Intel Gaudi 3

Gaudi 3 是这十张卡里让我心情最复杂的一张。

硬件底子真不差。台积电 5nm,128GB HBM2e,3.7 TB/s 带宽,1,835 TFLOPS FP8。最特别的是它集成了 24 个 200Gb 以太网口——别人多卡互联得额外买 NVLink Switch 或者 InfiniBand,Gaudi 3 直接用网线连。这架构思路其实很聪明。

直购十万左右,H100 的一半。实测也拿得出手:8 卡跑 70B FP8,21,138 tok/s,差不多 H100 的九成到九成五。每百万 token 推理成本是 H100 的六折。

那问题在哪?不在芯片。在 Intel。

2025 年 Gaudi 3 出货目标从 35 万颗砍到 20 万颗,全年营收预估 5 亿美元。隔壁 NVIDIA AI 业务 400 亿。更让人心里没底的是 Intel 管理层公开表态:短期内不会在高端 AI 训练领域跟 NVIDIA 正面竞争。你品品这话的意思。

软件栈也头疼。SynapseAI 到现在都没法跟 CUDA 比。Linux 内核社区甚至拒过 Gaudi 的驱动。

所以 Gaudi 3 适合什么人?你对 Intel 生态有信心、推理场景刚好卡在它的甜区(70B 以下 FP8)、同时你敢赌它的路线图不会断。三个条件全满足,它可能是你 ROI 最高的选择。缺一个?老老实实 NVIDIA。

第 6 名:华为昇腾 910C

昇腾 910C 可能是这次排名里争议最大的一张。放第六,有人觉得高了,有人觉得低了。

单看芯片参数,910C 打不过 H100。BF16 约 800 TFLOPS,大概 H100 的六到八成。中芯国际 7nm 级工艺跟台积电 4nm 有代差,良率大概四成,英伟达七成往上。纯单卡比,撑死排第八第九。

但华为做了一件很聪明的事:不跟你拼单卡,在系统层面翻盘。

CloudMatrix 384 超节点。384 张 910C 全对等互联,CPU 和 NPU 平起平坐,跨节点延迟不到一微秒。这个架构下跑 DeepSeek V3.2,单卡推理 2,300-2,400 tok/s。同一个场景 H20 只有 800。MoE 大模型推理,计算效率全面压过 H100。

几个硬数据:

- 中国电信用 910C 集群跑 DeepSeek 671B 满血版,单卡 2,122 tok/s,刷新了业界纪录

- 千卡集群训练线性度超 95%

- 国内近半数大模型用昇腾训练,GLM-5 就是 10 万张昇腾集群训出来的

- 2025 年 Q3 出货 70 万颗

- 推理成本大概是英伟达方案的十分之一

当然也得说实话。CANN 跟 CUDA 差距还很大,生态兼容性是硬伤。出了中国基本用不到这张卡。但就"制裁之下保算力底线"这件事来说,华为做得比大多数人想象的好得多。

第 5 名:AMD MI300X

MI300X 是 AMD 真正在 AI 市场站住脚的一张卡。

192GB HBM3。同期 H100 才 80GB,它是人家 2.4 倍。算力 2,615 TFLOPS FP8,比 H100 高一截。价格十万出头,H100 可是奔二十万去的。单看纸面,MI300X 简直按着 H100 打。

实际用起来也确实有两把刷子。大显存在推理场景是实打实的优势——同一个 70B,H100 得 Q4 量化才能单卡跑,MI300X 能用更高精度,或者同精度留更多 KV Cache 给长上下文。大 batch 推理,单卡并发用户数是 H100 的 2.3 倍。vLLM 上跑 GLM-5 这种 744B 的 MoE,TCO 甚至比 H200 还低。

但是。这一切有个前提:你搞得定 ROCm。

AMD 这两年软件上确实在拼了。ROCm 7.x 已经覆盖了 CUDA 12.5 大概九成二的 API,PyTorch、vLLM 这些主流框架官方支持也跟上了。但实际部署的时候,碰到冷门算子或者需要手写 kernel,该踩的坑一个都跑不掉。延迟也跟不上——同样八卡集群,推理延迟比 NVIDIA 高了三四成到七八成。

MI300X 就是那种"上限很高、下限也很低"的卡。搞好了比 H100 强还便宜,搞不好跑得还不如 A100。你团队里有没有 AMD FAE 资源?主要负载是不是 vLLM/PyTorch 这些适配好的框架?两个问题想清楚,答案就有了。

第 4 名:NVIDIA H100

H100 已经不是最新最强的卡了。但它仍然是目前最重要的卡。

从 GPT-4 到 DeepSeek V3.2 到 Qwen 3.5,你能叫得上名字的大模型,训练阶段几乎都跑过 H100 集群。过去三年,这张卡就是 AI 行业的水和电。

2026 年了,为什么我还把它放第四?

三件事。第一,生态。CUDA + NVLink 4(900 GB/s)+ MIG + Transformer Engine,这套东西在千万卡时级别的集群上跑了三年多,每一家 AI Infra 团队都知道怎么调、怎么修。换成 B200 或者 MI300X,光踩坑就得踩小半年。生产环境,稳定比性能重要一百倍。

第二,云上价格在持续跌。国内 H100 竞价已经降到五块多一小时了,70B 推理的每百万 token 成本完全可以接受。

第三,多卡能力。NVLink 4 加持,八卡 SXM 几乎线性扩展。MIG 还能把单卡切成七个实例跑多租户。

能跑什么?Qwen 3.5-27B FP16 单卡绰绰有余。Qwen 3.5-122B-A10B Q4 单卡 25-40 tok/s。DeepSeek V3.2 FP8 就得两张卡 NVLink 了。

一句话:不知道选什么?选 H100,大概率没错。

🏆 第 3 名:AMD MI325X

MI325X,简单概括:显存怪兽。

核心跟 MI300X 一样,还是 CDNA 3。显存从 192GB 拉到 256GB,带宽从 5.3 拉到 6.0 TB/s。价格十三四万,多出来的钱全砸显存上了。

256GB。2026 年 5 月这个时间点,所有你能买到的货架产品里,这就是最大的。B300 的 288GB 才刚开始小批量出货,大部分人根本拿不到。

这意味着什么?70B FP16 全精度跑完,还剩一百多 GB 给 KV Cache,长上下文随便造。MoE 更是它的绝对主场——DeepSeek V3.2 这种架构,显存占用大头是参数不是 KV Cache,大显存的优势直接被放大。百B 级别 MoE 跑 Q4,单卡搞定。在别的卡上想都不敢想。

vLLM 实测跑摘要类长上下文任务,MI325X 的 TCO 甚至压 H200 一头。

但老问题还是那个:ROCm。硬件底子确实强,软件能不能让你跑出理论性能的八成还是五成,全看你自己团队的功力。而且 MI325X 是过渡代——AMD 真正的大招是 MI355X(CDNA 4,3nm,FP4),现在买 325X 的人心里多少都会犯嘀咕:"我要不要再等等?"

我的看法:你如果天天跑 MoE 或者动不动 128K 长上下文,256GB 的 MI325X 是目前唯一选择。其他场景,要么 H200,要么等 MI355X。

第 2 名:NVIDIA H200

H200 是 H100 的"换显存不换芯"升级版。还是 Hopper 架构,FP8 算力一个数没变。但 HBM3 换成了 HBM3e,显存从 80GB 拉到 141GB,带宽从 3.35 拉到 4.8 TB/s。

直购十八九万,跟 H100 差不多。这一个改动直接把能跑的模型范围从"70B 以下"拽到了"70B 及以上"。以前 H100 跑 70B 得两张卡 NVLink,现在 H200 一张卡就够了。

CloudRift 今年一月的实测数据(8 卡集群,16K 上下文):

- GLM-4.5-Air AWQ 4bit → 5,463 tok/s

- Qwen3-Coder-480B AWQ(4 路张量并行)→ 4,263 tok/s

- GLM-4.6 FP8(8 路张量并行)→ 5,588 tok/s

还有个容易被忽略的细节:长上下文衰减。H200 从 2K 拉到 16K,吞吐掉了大概四成六。H100 掉了六成四。差距就在这里——KV Cache 不够用,多长的上下文都是白搭。

一张 H200 单卡跑 Qwen 3.5-122B-A10B Q4,60-80 tok/s,舒舒服服。加一张跑 FP16,直接上生产。多卡 NVLink 跑 DeepSeek V3.2,扩展性拉满。

云上竞价七八块一小时,每百万 token 成本不算最便宜。但 141GB 这个级别,生态、性能、稳定性全算上,没有真正的对手。

70B 级别,H200 就是那个你不需要思考的答案。

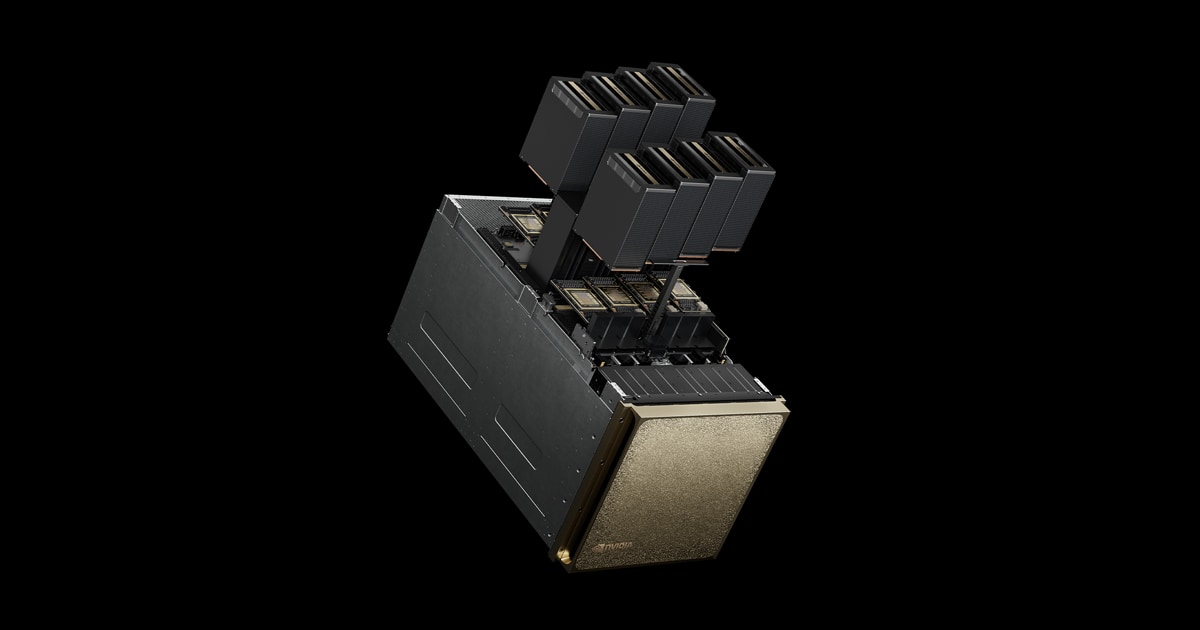

第 1 名:NVIDIA B200

第一没任何悬念。而且第二名离它差得不是一点半点。

Blackwell 架构,台积电 4NP,2080 亿晶体管,双 Die 通过 10TB/s 片内互联封在一起。几个数字:

- 192GB HBM3e,带宽 8 TB/s。H200 是 4.8,H100 是 3.35

- FP8 算力 4,500 TFLOPS(4.5 PFLOPS)。H100 的 2.27 倍

- 原生 FP4,开稀疏模式 18,000 TFLOPS(18 PFLOPS)

FP4 是 B200 最让我兴奋的东西。以前量化最低到 FP8,FP4 精度损失太大不敢上生产。Blackwell 第五代 Tensor Core 做了硬件级 FP4 支持,很多模型能做到速度翻倍、精度基本不掉。翻译一下:同样的模型、同样的效果,推理成本只有 H100 的三分之一到六分之一。

实测数据(MLPerf Inference v6.0,2026 年 4 月):

- 70B 级别 FP4 推理,单卡 B200 飙到 ~13,000 tok/s。同样场景 H200 约 7,800,H100 约 3,000。一脚油门到底,单卡就是 H200 的 1.7 倍、H100 的 4 倍多

- GPT-OSS 120B MoE FP8,8 卡 B200 冲到 93,071 tok/s,单卡均分 ~11,600 tok/s。H200 的三倍多

- DeepSeek R1 671B MoE,8 卡 B200 → 58,582 tok/s(offline 模式)

- 训练 70B:单卡顶俩 H200,速度快一半,成本低三成

NVLink 5,单卡 1.8 TB/s,八卡 HGX 总互联 14.4 TB/s。DGX B200 单机八卡,1,440GB 总显存,FP4 总算力 144 PFLOPS。这些数字放两年前说出来都没人信。

当然,没有完美的卡。B200 的毛病也很实在:

- 贵。一张二十多万打不住,八卡 DGX 奔两百万

- 热。单卡 1,000W,八卡满载 14kW+,不上液冷根本压不住

- 难买。2025 年 Blackwell 占了 NVIDIA 高端出货的八成三,但订单积压十二个月。你现在下单,拿到手可能已是 2027 年

- FP4 不是无脑用的,得你自己验证模型精度损失能不能接受

但这些毛病怪不了 B200——只能怪它太强了,强到所有人都想要,产能根本追不上。

看花了眼?直接按场景对号入座

个人玩家,想在自己电脑上跑模型:先来这里,查你现在这张卡能跑啥。Qwen、DeepSeek、GLM 主流模型全列出来了,还能看大概 tok/s。说不定你手里的卡已经够用了。真要升级?工作站上 RTX PRO 6000(96GB)。数据中心卡别碰,那功耗和散热不是你家里搞得定的。

创业公司搭推理 API,预算有限:7B-13B 上 L40S,阿里云竞价一小时两三块。70B 上 H100 或 H200。现阶段租,别买。现金流比固定资产重要。

自建机房训 70B+:首选 H200 八卡集群。预算够直接 B200。团队有 AMD 积累的话 MI300X/325X 能省不少硬件钱——但软件上多花的时间自己掂量。

国内买不到高端英伟达:昇腾 910C,唯一现实选项。推理已经很能打了,训练差距在缩小。但 CANN 迁移成本别低估。

主攻 MoE(DeepSeek 这种):显存优先。MI325X(256GB)、昇腾 910C CloudMatrix、B200 都行。看预算和供货选。

最后

写完了。

排名这东西永远有争议。每个人跑的场景不一样,打出来的分自然不一样。我这版综合了 MLPerf、各家白皮书和第三方实测,尽量客观,但你要觉得"第五跟第六该换一下"——太正常了,评论区聊。

其实核心就一句话:搞清楚你自己的场景到底需要什么卡。你的模型、你的预算、你的机房条件。想清楚了,来查一下实测数据,比看一万字评测都管用。

评论区见。

数据截至 2026 年 5 月。MLPerf v6.0 来源:mlcommons.org。实测数据来源:CloudRift、Spheron、Nebius 等云厂商公开 Benchmark。需要具体引用来源的评论区说。